Jusqu’ici quand un client cherchait une paire de chaussures, il tapait une requête, parcourait dix liens, comparait deux ou trois sites, et finissait souvent par découvrir une marque qu’il ne connaissait pas. Ce parcours est en train de disparaître. À sa place : une réponse unique, formulée par une IA, qui propose deux ou trois produits. Et qui propose désormais aussi de les acheter sans quitter la conversation.

Ce changement n’est pas qu’un détail d’interface (un lien “AI overview” par exemple). Il rebat les cartes de la visibilité commerciale d’une manière encore plus brutale que ne l’avaient fait, en leur temps, Google Ads ou la montée en puissance des marketplaces.

Pour les petites marques et les commerces locaux, qui ont déjà traversé deux décennies de rétrécissement progressif de leur fenêtre d’exposition, c’est une troisième vague. Probablement la plus dure.

Cet article tente de cartographier ce qui se met en place : les accords récents entre géants de l’IA et géants du commerce, le mécanisme d’appauvrissement des résultats, et la question centrale : quel espace reste-t-il pour ceux qui ne sont ni Amazon, ni Walmart, ni un million de marchands liés (et soumis) à Shopify ?

1. Avant l’IA, déjà un entonnoir qui se rétrécissait

Pour comprendre ce qui se passe aujourd’hui, il faut se rappeler d’où l’on vient.

Pendant vingt ans, la visibilité d’un commerçant en ligne s’est appuyée sur deux piliers : le référencement naturel sur Google, et la présence dans quelques places de marché. Les deux ont progressivement basculé vers la logique du péage.

Sur Google, la part de l’écran réservée aux résultats organiques s’est réduite à mesure que les annonces sponsorisées, le Shopping, les blocs pack local et les extraits optimisés occupaient le haut de la SERP. Sur les marketplaces, le constat est arithmétique : Amazon prélève typiquement entre 8 % et 15 % de commission de référencement sur les ventes tierces (selon les catégories), auxquels s’ajoutent les frais de fulfillment et, pour exister dans les premiers résultats, un budget de Sponsored Ads devenu quasi-obligatoire.

Pour une marque locale ou indépendante, le calcul était déjà serré. Mais au moins, il existait une issue : un client motivé pouvait toujours, en tapant le nom exact d’un produit ou en cliquant sur un lien organique, atterrir directement sur le site du marchand, sans intermédiaire. Cette issue est en train de se refermer.

2. Le basculement vers le zero-click

Le premier choc, déjà mesurable, est celui des AI Overviews et plus largement de la recherche générative. Les chiffres, qui s’accumulent depuis dix-huit mois, racontent tous la même histoire.

D’après Ahrefs, la présence d’un AI Overview en haut de la SERP est corrélée à une baisse de 34,5 % du CTR moyen sur les pages les mieux classées (le résumé généré par l’IA absorbe la requête et le contenu est consommé sans que l’utilisateur ne visite le site source). Une étude de BrightEdge publiée en mai 2025 estime la chute moyenne du CTR à 30 % depuis le déploiement progressif d’AI Overviews au premier trimestre 2025. Pew Research, repris par Ars Technica, parle de près de 50 % de clics en moins vers les sites externes lorsqu’un AI Overview est présent.

Le phénomène est désormais massif : 58,5 % des recherches Google aux États-Unis se terminent sans clic, et selon le cabinet de conseil Bain & Company, 80 % des consommateurs s’appuient sur des résultats zero-click au moins 40 % du temps, avec une baisse globale du trafic organique de l’ordre de 15 à 25 %. Forrester, cité par Le Ticket, mesure une baisse du trafic organique vers les sites web américains de l’ordre de 10 % sur la seule année 2024-2025.

Certains secteurs sont touchés plus durement que d’autres. Selon les données rassemblées par Dataslayer et The Digital Bloom à partir du core update de mars 2025, les requêtes déclenchant un AI Overview ont explosé dans l’entertainment (+528 %), la restauration (+387 %), le voyage (+381 %), l’immobilier (+258 %) et le transport. Les éditeurs de presse encaissent une partie du choc en bout de chaîne : 37 des 50 plus gros sites d’actualité américains ont vu leur trafic baisser en mai 2025 sur un an, CNN perdant entre 27 % et 38 % selon les périodes de mesure.

Pour un petit commerce, cela veut dire deux choses très concrètes :

- Les requêtes informationnelles autour de ses produits (« quelle est la différence entre tel et tel matériau », « comment choisir … ») ne génèrent plus de visites. La réponse est donnée dans l’AI Overview, et le contenu pédagogique investi par le commerçant sert désormais de matière première à l’IA, sans contrepartie en trafic.

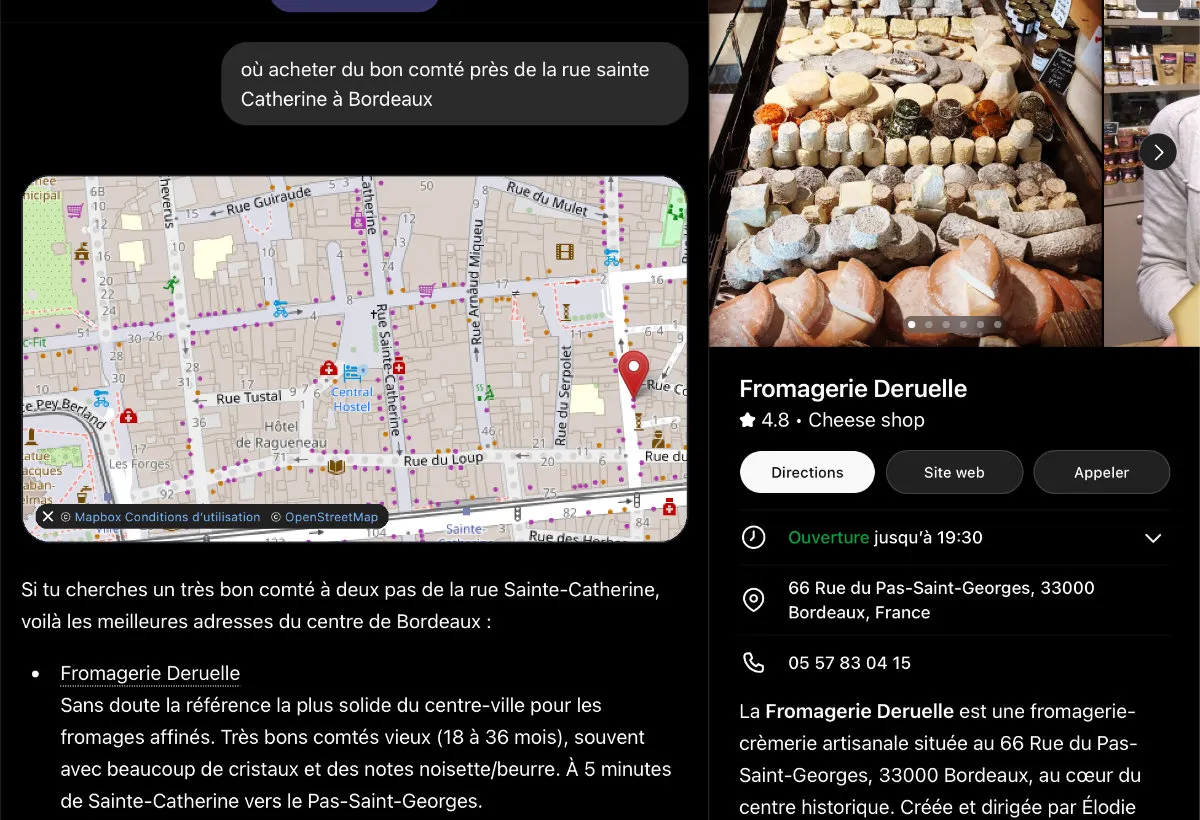

- Les requêtes locales (« meilleur fromager près de chez moi », « où acheter du fromage à Bordeaux ») sont massivement absorbées par les AI Overviews. La visibilité ne dépend plus du SEO local au sens classique, mais de la cohérence des données entre la fiche Google Business, le site, et les annuaires ; un travail différent, et que peu de petits commerçants ont structuré.

Sur ce dernier point, nous avons consacré deux articles à ce que les moteurs IA changent concrètement, et aux leviers techniques à actionner : GEO - démystifier l’optimisation pour les moteurs IA (1/2) et GEO - les leviers concrets pour rendre votre site citable par les IA (2/2).

3. Le commerce agentique : ce que les géants viennent d’acter

C’est dans ce contexte déjà éprouvant qu’arrive une seconde vague, plus directement transactionnelle : le commerce agentique. L’idée, un agent IA qui ne se contente pas de recommander mais qui achète à votre place, était dans les cartons depuis longtemps. Elle est devenue réalité industrielle à l’automne 2025.

Le coup d’envoi : septembre-octobre 2025 avec Instant Checkout

Le 29 septembre 2025, OpenAI annonce Instant Checkout dans ChatGPT, en partenariat avec Stripe. Les premiers marchands intégrés sont les vendeurs Etsy américains, avec l’arrivée prochaine de plus d’un million de marchands Shopify : Glossier, SKIMS, Spanx, Vuori, Steve Madden, etc. Le protocole sous-jacent, l’Agentic Commerce Protocol (ACP), est publié en open source.

Deux semaines plus tard, le 14 octobre 2025, Walmart annonce un accord avec OpenAI. Le plus grand distributeur américain rejoint l’écosystème ChatGPT Instant Checkout. Doug McMillon, son CEO, déclare que l’expérience e-commerce « consistait jusqu’ici en une barre de recherche et une longue liste de réponses » et qu’elle est sur le point de changer.

Le 11 janvier 2026, Shopify et Google annoncent à leur tour le Universal Commerce Protocol (UCP), co-développé entre les deux entreprises, déjà soutenu par plus de 20 retailers et plateformes. Les marchands Shopify peuvent désormais vendre directement dans AI Mode de Google Search et dans Gemini. Et Microsoft Copilot annonce une intégration similaire.

Les volumes sont massifs. Selon les données d’Adobe Digital Insights citées en mars 2026, le trafic IA vers les sites retail a augmenté de 4 700 % en glissement annuel à mi-2025. Shopify rapporte que les commandes attribuées à l’IA sur sa plateforme ont été multipliées par 11 entre janvier 2025 et janvier 2026. OpenAI revendique 2,5 milliards de prompts quotidiens, dont 2 % portent sur du shopping, soit 50 millions de requêtes d’achat par jour, sur 700 millions d’utilisateurs hebdomadaires.

L’échec d’Instant Checkout… six mois plus tard

Pourtant, fin mars 2026, OpenAI enterre discrètement Instant Checkout [1]. Les raisons sont à la fois techniques et structurelles. Sur l’aspect technique : OpenAI s’appuyait largement sur du scraping pour obtenir les données produits, ce qui produisait des informations de stock, de prix et de délais fréquemment inexactes. Emily Pfeiffer, analyste principale chez Forrester, le formule sans détour : le crawling et le scraping ne suffisent pas à donner la profondeur de données nécessaire pour une expérience d’achat satisfaisante.

Sur l’aspect structurel : promesse initiale d’« un million de marchands Shopify », réalité au moment de l’abandon, environ 30 marchands disponibles via Instant Checkout. Walmart avait mis 200 000 produits en ligne, c’est beaucoup, mais largement insuffisant pour couvrir un catalogue retail moderne. Et surtout, les taux de conversion étaient trois fois inférieurs à ceux d’un achat finalisé directement sur le site du retailer. Une étude Adobe-Semrush de mars 2026 sur plus de 1 000 consommateurs américains confirme la tendance : seulement 22 % des utilisateurs ont déjà acheté directement dans un outil d’IA, alors que 50 % déclarent avoir effectué un achat après avoir utilisé l’IA pour se renseigner. Les chatbots sont devenus de puissants outils de découverte, pas de finalisation.

Le nouveau modèle qui se met en place a un nom : « ChatGPT Apps ». Chaque retailer construit son propre agent et le branche dans ChatGPT. Walmart pousse Sparky directement dans ChatGPT et Google Gemini. Etsy développe sa propre app ChatGPT. Shopify confirme que ses marchands resteront visibles dans le chatbot, mais que le paiement se fera sur la boutique du marchand, plus dans le chat. L’idée générale est désormais de posséder l’agent et de louer la distribution.

Cette première phase d’agentic commerce, plutôt que de désintermédier, a donc révélé une autre vérité : aucun acteur n’a encore trouvé la formule. L’épisode mérite d’être retenu, non parce qu’il enterre définitivement le commerce agentique, mais parce qu’il illustre la vitesse à laquelle un canal peut apparaître, occuper tout le discours dans le secteur, puis disparaître en six mois. Pour un commerçant qui aurait construit sa stratégie sur Instant Checkout entre octobre 2025 et mars 2026, le retour à la case départ est un avertissement.

Le revirement Walmart : pilote du nouveau modèle

Walmart est devenu, dans cet épisode, l’illustration la plus claire du nouveau modèle. Plutôt que de laisser OpenAI gérer la transaction, le distributeur insère son propre agent maison, Sparky, directement dans ChatGPT et Google Gemini. Walmart paie un flat API fee à OpenAI, pas un partage de revenu. Et les premiers chiffres lui donnent raison : selon Walmart, les utilisateurs qui passent par Sparky dans ChatGPT finalisent leurs achats à environ 70 % du taux observé sur Walmart.com directement. Un résultat largement supérieur aux taux d’Instant Checkout.

Ce modèle révèle une asymétrie : seuls les très gros peuvent se payer un agent maison. Construire un Sparky n’est pas à la portée d’un marchand Shopify lambda. Et même si Shopify a annoncé que ses marchands resteraient visibles dans ChatGPT sans développement spécifique, la marge d’arbitrage sur les conditions reste, par construction, entre les mains de Shopify et d’OpenAI. Pas du marchand.

La bataille Amazon / Perplexity : l’autre versant

Pendant que Shopify, Walmart et Google entrent dans le jeu d’OpenAI, Amazon joue exactement la stratégie inverse : verrouiller son territoire.

En novembre 2025, Amazon poursuit Perplexity en justice. Le motif : le navigateur Comet de Perplexity faisait du shopping sur Amazon pour le compte des utilisateurs, et aurait délibérément déguisé ses sessions automatisées en sessions Chrome classiques pour contourner les blocages techniques mis en place par Amazon. Le 9 mars 2026, la juge fédérale du Northern District of California accorde à Amazon une injonction préliminaire interdisant à Comet d’accéder aux comptes Amazon protégés par mot de passe et exigeant la destruction des données collectées.

Amazon aurait bloqué des dizaines d’agents externes de sa plateforme, dont ChatGPT, tout en construisant son propre assistant Rufus, qui a généré près de 12 milliards de dollars de ventes incrémentales annualisées en 2025. Rufus revendique 250 millions d’utilisateurs en 2025 et un taux de conversion supérieur de 60 % aux parcours standards.

Le 13 mai 2026, nouveau virage : Amazon annonce abandonner le chatbot Rufus en tant que produit autonome pour intégrer ses capacités directement dans un nouvel agent shopping basé sur Alexa, inséré dans les résultats de recherche du site. Le calcul est clair : utiliser l’emplacement le plus précieux du site (les premiers résultats de recherche, jusqu’ici monétisés en Sponsored Products) pour pousser une recommandation algorithmique.

Et en février 2026, Amazon a investi 50 milliards de dollars dans OpenAI. Ce qui ressemblait à une guerre se rapproche d’un cartel.

4. Le passage caché : une nouvelle couche d’intermédiation

Voici ce qu’on ne dit pas assez clairement : l’IA ne désintermédie pas, elle ré-intermédie.

En janvier 2026, il est révélé qu’OpenAI prévoit de prélever 4 % de commission sur chaque vente Shopify effectuée via Instant Checkout. À cette commission s’ajoutent les frais Shopify habituels (abonnement + ~2,9 % de processing). Pour un marchand vendant via ChatGPT, le coût cumulé pouvait approcher 6,9 à 7,5 % par transaction, sans compter les coûts amont d’optimisation produit pour être lisible par l’IA.

Cette commission n’a finalement jamais été appliquée à grande échelle, puisqu’Instant Checkout a été enterré quelques semaines plus tard. Mais le chiffre publié est une donnée à retenir : c’est l’ordre de grandeur sur lequel OpenAI tablait pour monétiser le canal. Dès que le modèle suivant (ChatGPT Apps, agents maison branchés dans ChatGPT) aura trouvé sa formule économique, ce sera la base de négociation. La pression vers une intermédiation payante n’est pas neutralisée par l’abandon technique d’Instant Checkout : elle est seulement reportée.

À titre de comparaison, Amazon prend 8 à 15 % sur les ventes tierces, eBay autour de 10 %. Un nouveau prélèvement de 4 à 7 % ne serait, dans ce paysage, ni absurde ni dissuasif. Mais c’est une dépendance supplémentaire à un acteur unique, dont les conditions tarifaires sont opaques aujourd’hui et amenées à évoluer. OpenAI a mentionné que la publicité ferait tôt ou tard partie du modèle, ce qui place le commerce agentique sur la même trajectoire que Google Shopping : pas de placement préférentiel aujourd’hui, mais une fonctionnalité d’achat en chat qui prépare un Google Shopping in-chat.

Google AI Mode, de son côté, teste déjà des Shopping Ads dans son interface conversationnelle. La réponse à la question « le canal sera-t-il payant ? » est donc déjà connue : oui, dans un futur proche.

5. L’appauvrissement des résultats

Au-delà des aspects économiques, il y a un effet plus insidieux : la nature même de la réponse rétrécit l’éventail des choix.

Le biais de popularité mis en évidence

La recherche académique sur les systèmes de recommandation a depuis longtemps identifié le « popularity bias » : les algorithmes mettent en avant ce qui est déjà connu, au détriment de la longue traîne. Les LLM amplifient ce biais. Plusieurs études récentes [2] montrent que les modèles GPT surreprésentent les éléments populaires dans leurs recommandations, même quand la diversité est explicitement demandée dans le prompt.

La raison est mécanique. Un LLM apprend la fréquence statistique. Plus une marque est citée dans son corpus d’entraînement, plus elle est susceptible d’apparaître dans la réponse. Une marque locale, mentionnée dix fois sur le web, n’a aucune chance face à une marque citée dix mille fois. Des travaux plus anciens sur l’iniquité du biais de popularité dans les systèmes de recommandation l’avaient déjà formulé sans détour [3] : un marché dominé par ce biais concentre mécaniquement l’attention sur quelques marques connues, au détriment de la diversité et de l’innovation.

Trois liens deviennent un seul

L’effet d’entonnoir est arithmétique. Là où une SERP Google offrait dix résultats organiques cliquables, plus des résultats Shopping, plus une carte Maps, un AI Overview offre une synthèse. Là où ChatGPT recommande aujourd’hui trois ou quatre produits, les modèles qui se mettent en place (agents maison dans ChatGPT, intégrations Gemini, AI Mode) visent tous la même contraction du choix : une sélection courte, déjà filtrée, avec ou sans transaction native.

Anne-Claire Baschet, Chief Data & AI Officer chez Mirakl, citée dans Le Ticket, formule le diagnostic sans ambiguïté :

La conséquence : si une marque n’est pas dans les deux ou trois suggestions retenues par l’IA, elle n’existe pas.

L’effet de boucle

À cela s’ajoute un effet de second ordre [4] : à mesure que le web se remplit de contenus eux-mêmes générés par IA (descriptions produits, articles de blog, fiches comparatives), les futurs modèles s’entraîneront de plus en plus sur du contenu issu d’IA. Les chercheurs commencent à parler de déchets informationnels [5] pour qualifier cette production de masse de contenus normalisés, peu fiables, sans valeur ajoutée réelle, qui dilue la valeur globale de l’information disponible sur le Web. Le risque, c’est un nivellement : tout le monde finit par décrire ses produits avec les mêmes formulations, les mêmes arguments, les mêmes attributs. La singularité d’une marque locale (sa voix, sa façon de raconter) devient illisible pour les machines qui filtrent les choix.

Une intelligence sans ancrage, sans responsabilité

Il faut, en arrière-plan, garder une chose en tête. L’IA est une intelligence, au sens où elle traite, synthétise, recommande, et le fait avec une vitesse et une étendue qu’aucun humain n’égale. Mais sa différence avec l’humain n’est pas seulement quantitative. Elle est aussi qualitative, et profondément asymétrique : elle n’est ancrée dans aucun réel, et elle n’a aucun acte à assumer.

Le chercheur en sciences de l’information Arthur Perret a formalisé cette intuition [6]. Sa thèse, étayée par toute une tradition documentaliste (Buckland, Briet, Otlet) : les LLM sont des machines à communiquer, pas des machines à informer. Ils ne connaissent que les relations entre les mots, pas les relations entre les mots et les choses. Là où une fiche produit rédigée par un commerçant est un document (au sens technique de preuve à l’appui d’un fait), la réponse d’un LLM est un énoncé vraisemblable, qui n’a aucune valeur de preuve, de référence ou de témoignage. Perret parle d’un basculement d’un régime de vérité documentaire à un régime de vraisemblance.

Une étude de référence [7] va plus loin en mobilisant la notion de bullshit : non pas le mensonge (qui supposerait une intention de tromper) mais l’indifférence à la vérité. Les auteurs résument : les LLM ne perçoivent pas, donc ils ne peuvent pas mal percevoir ; le fait qu’ils tombent juste n’est qu’un résultat indirect de leur fonctionnement. La machine produit du discours statistiquement plausible. Que ce discours soit vrai ou faux est accessoire du point de vue du dispositif.

Au passage, Perret note finement que parler d’« hallucinations » pour qualifier les erreurs de ces systèmes est une commodité rhétorique : ça sous-entend que la machine essaie normalement de dire vrai et qu’elle s’égare parfois. Ce mode d’évitement n’est pas nouveau. Google avait depuis longtemps fait de « l’algorithme » un acteur autonome derrière lequel les arbitrages éditoriaux devenaient indiscutables (« ce n’est pas nous qui décidons, c’est l’algorithme »). Avec les LLM, le même tour de passe-passe se rejoue, d’autant plus efficace que le système est encore plus opaque : appeler « hallucination » ce qui est en réalité le mode de fonctionnement standard du dispositif, c’est faire de l’erreur un accident de parcours plutôt qu’un trait du dispositif lui-même ; et c’est s’épargner les épreuves de justification.

Quand un fromager bordelais recommande un comté, il l’a goûté, il l’a affiné, il a négocié son prix avec un producteur qu’il connaît, et il sait qu’un client mécontent reviendra le lui dire le samedi suivant sur le marché. Sa recommandation l’engage, économiquement et socialement. Quand une IA recommande un produit, elle n’a goûté à rien, elle n’a parlé à personne, elle ne reçoit aucun retour, et si la recommandation est mauvaise, il n’y a personne à qui s’adresser : ni l’IA, qui ne ressent rien, ni la plateforme qui l’héberge, qui se protégera par ses conditions générales d’utilisation. Le risque est intégralement transféré au commerçant en bout de chaîne et au consommateur.

Cette asymétrie a deux conséquences pratiques. D’abord, rien dans le fonctionnement de l’IA ne la pousse à arbitrer en faveur de la qualité réelle d’un produit ou d’un service : elle arbitre en faveur de ce qui est le mieux documenté, le mieux structuré et le plus statistiquement fréquent dans son corpus, ce qui n’est pas la même chose. Ensuite, le seul acteur de la chaîne qui assume encore quelque chose (sa réputation, sa solvabilité, son rapport à ses clients), c’est le commerçant lui-même.

Dit autrement : dans un monde où une partie croissante des choix est faite par des machines sans ancrage et sans conséquence, ce qui a de la valeur pour le client, c’est précisément ce qui en a : un humain qui répond, un magasin où entrer, une marque qui réparera. Cette asymétrie est, paradoxalement, l’un des rares atouts solides qui restent aux commerçants indépendants.

Et le client lui-même s’érode

Un dernier angle, rarement évoqué. L’appauvrissement ne porte pas que sur l’offre (moins de marques visibles) ; il porte aussi sur la demande, sur les capacités cognitives du consommateur lui-même.

Plusieurs études récentes documentent les effets de l’usage régulier des LLM sur les capacités mentales de leurs utilisateurs : dépendance à la machine et baisse des performances d’apprentissage en autonomie [8] ; diminution des capacités de mémorisation [9] ; érosion de l’esprit critique et du raisonnement [10]. Le mécanisme est simple : plus on délègue, moins on entraîne le muscle.

Pour un commerçant, c’est un changement de terrain. Pendant vingt ans, son client tapait dix requêtes sur Google, comparait trois sites, lisait des avis, doutait, revenait, comparait encore. Ce parcours, certes fastidieux, était aussi un parcours d’autonomisation : le client se forgeait un avis, il devenait expert de son propre besoin. C’est ce parcours qui rendait possible la rencontre avec une marque inconnue, parce qu’il y avait du temps pour douter et de l’envie de chercher.

Avec l’IA conversationnelle, ce parcours se contracte. Le client demande, l’IA répond, le client achète. La capacité même de comparer, de douter, de chercher au-delà de la première proposition, s’atrophie à mesure que l’usage s’installe. Le commerçant indépendant ne se bat plus seulement contre un algorithme qui ne le voit pas ; il se bat aussi contre un client qui a perdu l’habitude de chercher.

C’est sans doute le déplacement le plus lourd des cinq prochaines années, et le moins discuté dans les conférences e-commerce. Pourquoi ? Parce qu’on est pressés par la vitesse et les résultats. Les marchands s’adaptent dans l’urgence, ballotés par un mouvement de société plus profond et qui les dépasse. On parle outils, on parle canaux, on parle conversions. On ne parle pas du client qui, lui aussi, se transforme.

6. Quel espace pour les petites marques et les commerces locaux ?

Le tableau jusqu’ici est sombre. Mais le diagnostic n’est pas qu’à charge.

Plusieurs études récentes montrent que le commerce agentique, paradoxalement, peut rééquilibrer certaines cartes, à condition de comprendre ce qui change.

Le local, paradoxalement, devient un avantage

L’étude IBM-NRF citée par la plateforme Faire indique que 40 % des Français utilisent déjà l’IA pour guider leurs achats. Mais une autre donnée, relayée par Partoo via OpinionWay, est moins commentée : plus d’un tiers des Français envisagent déjà d’utiliser une IA pour trouver un commerce local. Et les requêtes locales ont vu leur taux de couverture par les AI Overviews exploser (+273 % pour la restauration). Autrement dit : si vous êtes fromager à Bordeaux, le client ne va plus chercher « fromagerie Bordeaux » sur Google, il va demander à ChatGPT « où acheter du bon comté près du marché des Capucins ». Le canal change, mais l’intention reste. Et reste locale.

Le déterminant de visibilité, en revanche, n’est plus le même. Les IA n’arbitrent pas sur le PageRank ou la densité de mots-clés. Elles arbitrent sur la cohérence et la richesse des données structurées : horaires à jour, adresse identique partout, avis clients fréquents et de qualité, description claire, attributs précis (sans gluten, sans lactose, label bio, fabrication locale). C’est un terrain où une bonne fromagerie indépendante, méticuleuse sur sa fiche Google et son site, peut battre une grande surface qui a négligé sa donnée locale.

Le risque de la dépendance : ne pas rejouer le piège Google

Pendant quinze ans, l’acquisition en ligne s’est appuyée presque exclusivement sur Google, non par choix, mais parce que la position dominante du moteur ne laissait pas d’alternative crédible. La conséquence est connue : le jour où l’algorithme a changé, ou le jour où le coût-par-clic a doublé, des milliers d’e-marchands n’ont plus rien eu pour amortir le choc.

Le commerce agentique se met en place sur la même mécanique, mais avec des intermédiaires plus jeunes et moins régulés. L’épisode Instant Checkout illustre la fragilité de ces canaux mieux qu’aucun argument théorique : annoncé en grande pompe en septembre 2025 comme « la prochaine étape du commerce », enterré six mois plus tard, fin mars 2026. Pour les marchands qui avaient orienté leurs efforts vers cette intégration spécifique, c’est six mois de chantier produit et de communication remis en cause.

Ce que cet épisode confirme :

- les conditions tarifaires sont opaques (le 4 % de commission n’a été révélé qu’après coup, par une fuite presse) et amenées à évoluer ;

- la publicité reviendra tôt ou tard pour passer en tête des recommandations ;

- la fonctionnalité elle-même peut disparaître du jour au lendemain, y compris après avoir été présentée comme une révolution.

Le modèle qui prend le relais (« ChatGPT Apps », agents maison des grands retailers branchés dans ChatGPT) ne corrige pas ces fragilités. Il les déplace. Construire son propre agent (un Sparky comme Walmart) n’est pas à la portée d’un marchand qui ne pèse pas plusieurs centaines de millions de chiffre d’affaires. Pour les autres, la solution Shopify (visibilité sans développement spécifique, paiement chez le marchand) est plus accessible. Mais elle reste régie par des conditions définies entre Shopify et OpenAI, sans aucune marge de négociation pour le marchand individuel. Le lien technologique avec le fournisseur de la solution reste très fort et très risqué. Nous avons développé ce point ailleurs : le risque des plateformes SaaS et la question de la réversibilité.

Ce qui résiste, et ce qui se construit

Ce qui résiste, ce sont les canaux que le marchand maîtrise : son propre site, sa liste email, sa communauté (Instagram, newsletter, communauté locale physique), son magasin. Aucun de ces canaux n’est filtré par un agent IA. Un site sous Magento Open Source ou WordPress, dont le marchand possède le code, la base de données et le fichier client, est par construction un actif que personne ne peut éteindre du jour au lendemain.

Ce qui se construit, c’est le GEO (Generative Engine Optimization) : produire du contenu factuel, dense, citable par les IA, structuré en Schema.org, avec des données produit complètes (matériaux, dimensions, garanties, certifications, retours). Pour un marchand, c’est un chantier concret : enrichir les attributs produits, soigner les fiches, structurer les avis clients, publier du contenu éditorial à forte densité factuelle. C’est un travail de fond sur la qualité de la donnée - exactement ce que nous détaillons dans notre guide GEO en deux parties.

Enfin, il y a ce que Laëtitia Muré, CEO de Feed Manager, appelle la sortie de « l’écrin de la marque » : accepter que la fiche produit ne soit plus seulement vue par un humain visitant son site, mais qu’elle soit ingérée, comparée et restituée par une IA. Cela implique de réécrire des listes à puces, d’élargir les champs sémantiques, d’exposer les attributs techniques.

7. Conclusion : la résilience est un choix d’architecture

L’histoire qui se déroule sous nos yeux est celle d’une recomposition de la chaîne de visibilité commerciale. Les géants signent entre eux : OpenAI avec Stripe, Walmart avec OpenAI, Shopify avec Google, Amazon contre tous les autres en attendant son propre agent. Les petites marques et les commerçants indépendants, eux, n’ont pas de table à laquelle s’asseoir.

Quatre principes utiles, du point de vue d’un commerçant qui veut continuer à exister dans cinq ans :

Diversifier les canaux d’acquisition. Ne plus dépendre à 80 % d’un seul flux (Google, ChatGPT, Instagram, Amazon). Construire sa base email, sa communauté, ses partenariats locaux, sa boutique physique le cas échéant. Un canal propriétaire est le seul qui ne dépend pas d’un changement d’algorithme ou d’un nouvel accord entre deux géants.

Posséder ses outils et ses données. Au-delà des canaux d’acquisition, la question est celle de l’infrastructure elle-même : qui possède le site, qui héberge la base produit, qui détient le fichier client, qui contrôle le CRM et les automatisations. Louer son outil commercial à un acteur unique (un SaaS qui peut changer ses conditions, fermer un compte, augmenter ses tarifs, restreindre l’export des données) revient à se mettre dans la même dépendance que sur Amazon ou Google, à un échelon plus profond encore. L’indépendance vis-à-vis des plateformes commence par la propriété des outils. C’est moins spectaculaire qu’une intégration agentique. C’est infiniment plus solide.

Investir dans la qualité de la donnée produit. C’est désormais la matière première dont les IA se nourrissent. Une fiche pauvre est un produit invisible. Une fiche riche, factuelle, bien structurée, avec attributs, avis et certifications, devient un avantage compétitif.

Refuser la dépendance plateformaire absolue. Être présent dans les Agentic Storefronts ou les futurs ChatGPT Apps peut faire sens pour capter un nouveau trafic. Mais y construire l’intégralité de son chiffre d’affaires, c’est se mettre dans la situation de ceux qui ont misé tout sur Amazon ; et qui ont vu leurs marges fondre quand la commission s’est ajustée à la hausse. C’est aussi prendre le risque, comme l’a montré l’épisode Instant Checkout, de voir le canal disparaître en six mois.

Le commerce agentique n’est pas une fatalité d’appauvrissement. Mais il est, par construction, un mécanisme de concentration : moins de propositions affichées, plus de pouvoir aux intermédiaires, plus de standardisation des réponses. Il fait reposer une part croissante de l’arbitrage sur des systèmes qui n’ont, eux, rien à perdre dans l’opération. Pour les petites marques, l’enjeu n’est pas de gagner cette bataille (elles ne la gagneront pas frontalement), c’est de bâtir une architecture commerciale suffisamment résiliente pour que la perte progressive du canal Google et l’apparition du canal IA ne soient pas, à elles deux, des coups fatals. Et de continuer à faire valoir, dans la relation client, ce que la machine ne reproduit pas : un ancrage, une présence, une responsabilité assumée.

C’est probablement la conversation à avoir, en 2026, avec tout dirigeant qui pense encore que le sujet est purement technique.

Vous voulez bâtir une architecture e‑commerce qui ne dépend pas du bon vouloir d’OpenAI, de Shopify ou de Google ?

Parlons de votre stratégie e-commerce

Notes et sources

[1] Sellitto, Johan, OpenAI abandonne Instant Checkout : ce que l’échec du paiement dans ChatGPT révèle, Abondance, 24 mars 2026. https://www.abondance.com/20260324-2046117-openai-abandonne-instant-checkout-ce-que-lechec-du-paiement-dans-chatgpt-revele.html. Reprend notamment les déclarations de Daniel Danker (Walmart) à la conférence Morgan Stanley début mars 2026, les analyses d’Emily Pfeiffer (Forrester) et de Bob Hetu (Gartner), et l’étude Adobe-Semrush de mars 2026.

[2] Di Palma, Biancofiore, Anelli et al., Exploring Diversity, Novelty, and Popularity Bias in ChatGPT’s Recommendations, arXiv, 2025. FairLRM: Bridging Semantic Understanding and Popularity Bias with LLMs, arXiv, 2026.

[3] Abdollahpouri, Burke et Mobasher, The Unfairness of Popularity Bias in Recommendation, DePaul University (Chicago), arXiv, 2019. https://arxiv.org/abs/1907.13286

[4] UCLA Anderson Review, AI from AI: a Future of Generic and Biased Online Content?, janvier 2025.

[5] Copestake, Duggan, Herbelot, Moeding et von Redecker, LLMs as supersloppers, Cambridge Language Sciences Annual Symposium, 2024.

[6] Perret, Arthur, L’intelligence artificielle générative dans l’impasse informationnelle, XXIVe Congrès de la SFSIC, juin 2025. https://hal.science/hal-05126355 - version publique sur le blog de l’auteur : arthurperret.fr

[7] Hicks, Humphries et Slater, ChatGPT is bullshit, Ethics and Information Technology, vol. 26 n°2, 2024. https://link.springer.com/article/10.1007/s10676-024-09775-5

[8] Bastani, Bastani, Sungu, Ge, Kabakcı et Mariman, Generative AI Can Harm Learning, SSRN, 2024.

[9] Abbas, Jam et Khan, Is it harmful or helpful? Examining the causes and consequences of generative AI usage among university students, International Journal of Educational Technology in Higher Education, 2024.

[10] Gerlich, AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking, Societies, vol. 15 n°1, 2025.